YouTube zmusza twórców do ujawniania wykorzystania sztucznej inteligencji, ale nie zawsze

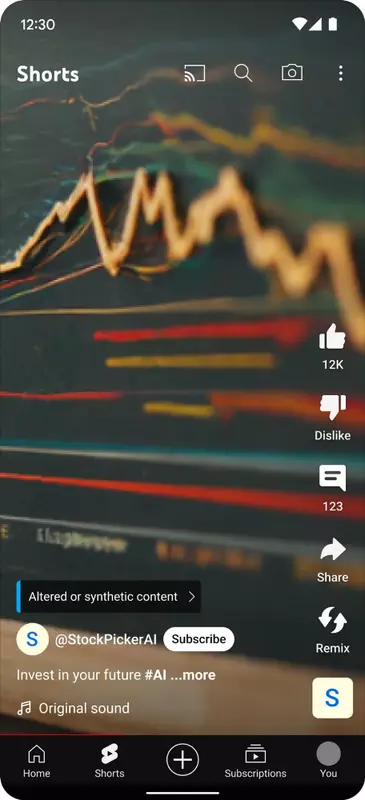

YouTube wymaga teraz od twórców treści ujawniania, kiedy używają sztucznej inteligencji do zmiany treści dla jasności widzów. Treści, które muszą być oznaczone, obejmują zmienione obrazy osób lub wydarzeń, które nie miały miejsca, aby odróżnić fakty od fikcji. Tagi ujawniania sztucznej inteligencji będą bardziej widoczne w przypadku niektórych tematów, takich jak zdrowie, wiadomości, wybory lub treści finansowe.

Co już wiadomo

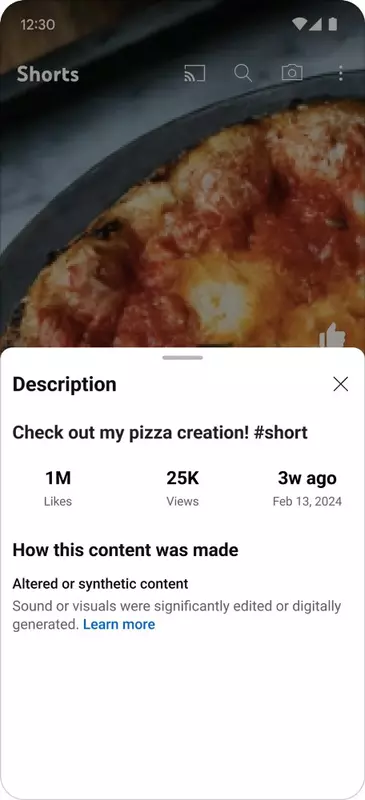

W ogłoszeniu opublikowanym na stronie pomocy YouTube, Google twierdzi, że uruchamia nowe narzędzie, które będzie wymagało od twórców YouTube wskazania, kiedy wykorzystali sztuczną inteligencję do tworzenia treści. Informacje te są następnie wyświetlane w rozszerzonym opisie treści, gdzie widzowie mogą dowiedzieć się, w jaki sposób to, co widzą, zostało zmienione. Treści, które mają zostać oznaczone, obejmują wszystko, co sprawia, że dana osoba mówi lub robi coś, co w rzeczywistości nie miało miejsca, a także zmienione obrazy rzeczywistego wydarzenia lub miejsca. Generowanie dźwięku przez sztuczną inteligencję również będzie oznaczane w ten sam sposób.

Chociaż może być dość łatwo przegapić te powiadomienia w rozszerzonym opisie, Google zauważył, że sprawi, że te powiadomienia będą bardziej widoczne w treściach na określone tematy. Na przykład filmy na YouTube dotyczące medycyny, wiadomości, wyborów lub kwestii finansowych będą miały bardziej oczywisty tag ujawnienia sztucznej inteligencji.

Jednak niektóre treści nie potrzebują tagu, aby zostać uwzględnione w AI. Stosowanie filtrów światła lub specjalnych efektów tła nie musi być ujawniane. Twórcy nie muszą również oznaczać treści, jeśli sztuczna inteligencja jest wykorzystywana do kwestii produkcyjnych, takich jak generowanie skryptów. Google twierdzi, że jeśli zmiany AI w treści są "niewielkie", zgłaszanie tych zmian jest opcjonalne.

Źródło: Youtube