Google I/O 2024: era Gemini w wyszukiwarce - sztuczna inteligencja będzie tworzyć rysunki, filmy i muzykę oraz ostrzegać przed oszustami telefonicznymi

Na trwającej właśnie konferencji Google I/O wyszukiwarkowy gigant pokazał, że nie zamierza rezygnować z pozycji lidera we wprowadzaniu sztucznej inteligencji. Sztuczna inteligencja zostanie ściślej zintegrowana ze Zdjęciami Google, Aparatem Google, Gmailem, wyszukiwarką i innymi aplikacjami, a Gemini stanie się głównym osobistym asystentem, z którym można komunikować się za pomocą tekstu, głosu i aparatu.

Google I/O 2024: najważniejsze informacje

- Gemini stanie się teraz głównym asystentem w systemie Android. Nic nie wiadomo o losie Asystenta Google, ale wszyscy znamy zwyczaje Google.

- Generowanie obrazów - zgodnie ze szczegółowym opisem Gemini będzie tworzyć obrazy nawet nieistniejących obiektów. Można również tworzyć piękne podpisy.

- Generowanie wideo według opisu. Wideo można wydłużyć do żądanego czasu trwania. Bardzo obiecujące narzędzie dla blogerów, aby uzyskać darmowe tematyczne wstawki wideo.

- Music AI Sandbox - narzędzie do generowania próbki muzyki na podstawie opisu tekstowego lub przetwarzania wejściowej ścieżki dźwiękowej.

- Zdjęcia Google będą teraz analizować pełny kontekst zdjęć. Możliwe będzie nie tylko wyszukiwanie zdjęć po opisie tego, co zostało na nich zrobione, ale także dokonywanie selekcji tematycznych, na przykład postępów z treningów na przestrzeni roku itp.

- API Gemini 1.5 Pro to model językowy, który zapewni 1 mln tokenów do przetwarzania zapytań, zapamiętywania historii konwersacji i uwzględniania największego kontekstu wśród konkurentów. Liczba dostępnych tokenów zostanie podwojona latem. Gemini 1.5 Flash - Szybki interfejs API sztucznej inteligencji zapewniający wyniki w czasie zbliżonym do rzeczywistego.

- AI do nauki usystematyzuje i wyjaśni materiał do nauki, w tym codzienne przykłady.

- Circle to search - chip zapowiedziany w Galaxy S24 Ultra, który następnie trafił do Google Pixel, wkrótce pojawi się we wszystkich smartfonach z Androidem. Dla przypomnienia, wystarczy zakreślić obiekt na ekranie, aby Google określiło, co dokładnie jest tam przedstawione i uruchomiło wyszukiwanie tego obiektu.

- Głęboka analiza kontekstu. Na przykład, jeśli poprosisz Gemini o zorganizowanie podróży, nie tylko kupi bilet, ale także zasugeruje miejsce na pobyt i sprawdzi prognozę pogody. Z kolei zamawiając buty, będzie w stanie dopasować rozmiar na podstawie korespondencji z Gmaila.

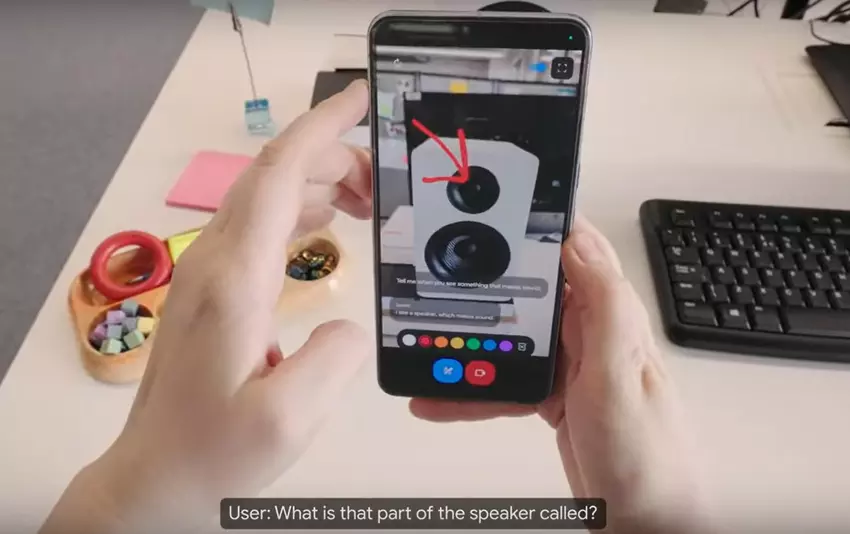

- Gemini można zapytać nie tylko za pomocą tekstu lub głosu, ale także za pomocą kamery. W filmie demonstracyjnym Gemini wyjaśnił, co robi obiekt w kadrze, analizuje kod oprogramowania w locie i wyjaśnia, co robi, rozwiązuje zagadki, pamięta, gdzie znajdował się obiekt, który był wcześniej widziany w kadrze.

- Era wyszukiwania Gemini. Wyszukiwanie nie tylko będzie natychmiast generować fragmenty i odpowiedzi generowane przez sztuczną inteligencję, ale będzie teraz w stanie tworzyć plany i zadania. Będziesz mógł wprowadzać złożone zapytania, a następnie Gemini wyznaczy trasę, sprawdzi ocenę lokalu lub w razie potrzeby utworzy menu na tydzień, natychmiast tworząc listę zakupów i miejsc, w których można je zrobić.

- Gmail będzie teraz udostępniał zestawienie wiadomości e-mail i możliwe będzie łączenie wielu wiadomości e-mail i wykonywanie zestawienia wiadomości e-mail razem. AI będzie również w stanie odpowiedzieć wszystkim nadawcom tych e-maili, dodać zadania do kalendarza, a nawet utworzyć tabelę Arkuszy Google wszystkich podobnych ofert, które dotarły pocztą.

- W przypadku pracy zespołowej Gemini przeanalizuje wszystkie czaty robocze, wyszuka i przeanalizuje zawarte w nich informacje oraz odpowie właściwym współpracownikom, nawet jeśli nie wiesz, na którym czacie toczy się właściwa dyskusja.

- Gemini można przesłać plik PDF zawierający do 1500 stron do analizy i poprosić o wykonanie krótkiego tłumaczenia. Gemini przeanalizuje wszystkie fragmenty i w razie potrzeby pokaże dokładnie ten segment, którego potrzebuje użytkownik.

- Gemini można zapytać, dlaczego określony mechanizm nie działa, na przykład konsola DJ-a lub kamera, a sztuczna inteligencja udzieli odpowiedzi, jak go naprawić. Aby to zrobić, sztuczna inteligencja rozpoznaje mechanizm w ramce, jego model, działanie, które użytkownik próbuje wykonać, wykorzystuje te dane do wyszukiwania, analizuje je i wyodrębnia dokładnie niezbędne informacje.

- AI dla programistów wygeneruje kod zgodnie z opisem zadania, stworzy bazę zdjęć obiektów i wyszuka błędy.

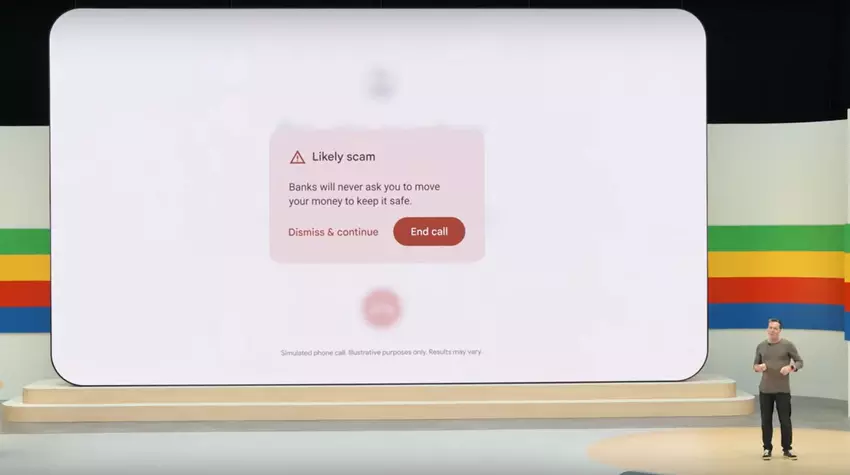

- Ochrona przed nieuczciwymi połączeniami. Sztuczna inteligencja będzie analizować rozmowy w czasie rzeczywistym, a jeśli rozmówca zachowa się podejrzanie, na przykład poprosi o podanie danych bankowych, wygeneruje sygnał dźwiękowy i ostrzeżenie o możliwym oszustwie.

- Sztuczna inteligencja będzie obsługiwać 35 języków i będzie miała największe okno kontekstowe spośród wszystkich konkurentów.

W tym roku Sundar Pichai odpowiedział na humor związany z zeszłoroczną prezentacją Google I/O i od razu podał statystykę, że akronim "AI" został wypowiedziany 120 razy podczas prawie 2-godzinnej prezentacji. A potem jeszcze raz.

Źródło: Google I/O